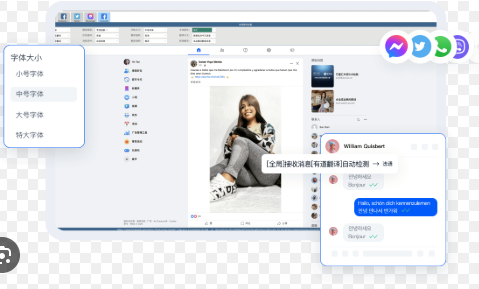

HelloWorld翻译软件翻译错误怎么分类统计

将翻译错误按层级化体系分类并统计:一级分词汇、语法、术语、语用、语境、格式与标点、遗漏与多译、风格文化八类;二级细分词形、词义歧义、搭配、时态语序、术语一致性、数值与单位、代词指代、礼貌语气等;按语言对、领域、场景分层抽样,人工标注结合自动检测,记录错误类别和严重度,计算错误率,输出按语言对、领域分布。

Table of Contents

Toggle为什么要给翻译错误分类并统计?

一句话说清楚:不把错误拆开看,就很难改。HelloWorld 这样的翻译产品面对数百种语言、各种业务场景,错误看起来混成一堆,工程师会抓不住重点,产品经理也很难给出可执行的优化路线。按类别统计能做到两件事——一是找出最常见、最致命的错;二是量化改进前后的效果(不是凭感觉)。

用费曼法简单解释一下

想象你在修一辆车。如果机械师只告诉你“车有问题”,你就不知道从哪里开始;但如果他说“刹车片磨损、轮胎气压低、机油不足”,你马上就知道优先顺序。翻译错误分类就是把“车有问题”拆成具体零件,便于修复与统计。

翻译错误分类体系(推荐分级)

一个实用的分类既要覆盖面广,又要能落地标注。下面给出一个常见且可操作的分级体系,供 HelloWorld 用于统计与分析。

| 一级类别 | 含义(简述) |

| 词汇错误 | 单词/短语选择不当、错译、漏译同义替换错误 |

| 语法错误 | 词形、时态、语序、搭配等导致句子不通或语法不合法 |

| 术语错误 | 专业术语、品牌名、约定用语翻译不一致或错误 |

| 语用与语境错误 | 翻译忽略上下文,导致语气、指代、含义偏差 |

| 格式与标点错误 | 数字、日期、单位、标点和排版相关的错误 |

| 遗漏与多译 | 信息缺失或冗余(原文信息未翻译或重复翻译) |

| 风格与文化错误 | 不符合目标语言文化或不恰当的表达风格 |

二级细分举例(更细的标注项)

- 词汇类:词义歧义选择错误、近义词替换不当、错拼写。

- 语法类:动词形态错误、主谓不一致、连接词缺失。

- 术语类:术语未归一、域内翻译不统一、缩略语处理错误。

- 语用/语境:代词指代错误、上下文依赖未处理、对话场景中的角色混淆。

- 格式/标点:数字千分位、货币符号、时间格式、句子断句问题。

- 遗漏/多译:片段缺失、重复片段、片段顺序颠倒导致信息丢失。

- 风格/文化:习语直译、礼貌程度不适当、禁忌用语误用。

如何做采样与标注(落地步骤)

这部分是操作手册式的内容:不讲太抽象,直接说能干的步骤。

1) 确定采样策略

- 按语言对分层抽样(高流量语言对要多抽样);

- 按领域分层(电商、技术文档、聊天对话、法律、医疗等);

- 按场景采样(网页、App内提示、客服对话、图片识别结果等)。

简单的样本量建议:每个语言对×领域组合,至少抽取 300–1000 条样本以得到稳定的误差估计(置信区间与可接受误差相关)。如果要检测 1% 级别的变化,样本需求将显著增大。

2) 设计标注说明书(Annotation Guideline)

- 每个一级类别给出明确定义;

- 每个二级子类提供示例(错误/正确对比);

- 引入严重度标签:轻微/中等/严重(对应不同的权重);

- 规定标注元数据:语言对、领域、来源、设备、模型版本、置信度等。

3) 标注流程与质量控制

- 双标或三标制:每条样本至少由两位标注员独立标注;

- 冲突集合由高级标注员或专家复核;

- 周期性抽样检查与标注员培训;

- 计算一致性指标(见下文)。

一致性与置信度:如何衡量标注质量

两个标注员看到同一句话是否会选同一个错误类别,这很关键。常用指标:

- Cohen’s kappa:二人标注一致性,考虑随机一致概率;

- Fleiss’ kappa:多标注员扩展;

- 百分比一致率:直观但不考虑随机一致。

实务中,如果 kappa < 0.6 就需要回滚标注说明书或加强培训。标注一致性差通常说明类别定义不清或样本太模糊。

关键统计指标与计算方式

这里列出可直接用的指标,和为什么它们有意义。

| 指标 | 计算方法 | 意义 |

| 错误率(Error Rate) | 错误条数 ÷ 总条数 | 最基础、直观的质量度量 |

| 加权错误得分(Weighted Error Score) | Σ(错误_i × 严重度权重_i) ÷ 总条数 | 把轻重不同的错误综合成一个分数 |

| 每词错误率(WER-like) | 错误词数 ÷ 总词数 | 对长短句敏感,适合文本长度变化大的集 |

| 类别分布 | 每类错误数 ÷ 错误总数 | 显示哪些类型问题占比高 |

举个公式化但易懂的写法:加权错误得分 = (Σ_j N_j × w_j) / N_total,其中 N_j 是第 j 类错误数,w_j 是该类的严重度权重。

如何把自动检测与人工标注结合起来

完全人工标注成本高,也慢;完全自动又不够精准。常见的折中方式:

- 先用规则或模型做自动筛查,找出高置信度的“无错误”或“明显错误”;

- 对低置信度与高风险样例做人工复核;

- 使用主动学习:把模型不确定的样本优先送标注,用以提升模型;

- 把人工标注的结果回流到规则库与模型训练数据,形成闭环。

按语言对、领域与场景做对比分析的技巧

不同语言对的错误性质不同:例如中→英在时态、冠词上可能错得多,英→中在词序和文化意译上常见错误。要做公平比较,需要归一化和分层控制:

- 按相同领域抽样再比较;

- 按文本长度或句式复杂度分层;

- 展示“错误率/千词”或“每千句错误数”以避免规模偏差;

- 用置信区间表明差异是否显著。

可视化报表与监控面板要点

有数据但看不懂不如没数据。常用的几个视图:

- 饼图/条形图:显示错误类别占比;

- 热力图:语言对 × 错误类别,快速定位薄弱环节;

- 趋势线:随模型版本或时间的错误率变化;

- 漏斗图:自动检测→人工复核→修复率;

- 示例抽样窗格:随机或按严重度抽取实例供人工核查。

举个实践中的小案例(演示用)

假设我们对 en→zh 的客服短句做了 1000 条抽样标注,结果如下(示例数字,便于理解):

| 类别 | 错误数 | 占比 | 严重度权重 |

| 词汇 | 220 | 27.5% | 1 |

| 语法 | 180 | 22.5% | 1.2 |

| 术语 | 140 | 17.5% | 1.5 |

| 语用/语境 | 120 | 15.0% | 1.8 |

| 格式/标点 | 80 | 10.0% | 0.8 |

| 遗漏/多译 | 40 | 5.0% | 2.0 |

基于上表:错误率 = (220+180+140+120+80+40) / 1000 = 0.78(78% 的样本至少有一类错误,示例);加权得分按权重计算则能更好反映严重影响(比如遗漏/多译权重高,虽数量少但影响大)。

常见误区与注意事项

- 误区:把 BLEU 或单一自动指标当作错误分类的全部依据。说明:自动指标只能作为参考,不能代替人工语用判断。

- 误区:只统计错误条数不看严重度。说明:很多轻微风格问题没必要优先修复,重点应放在高权重的错误上。

- 注意:标注规则要不断迭代,随着产品场景和用户反馈更新样例库。

- 注意:数据漂移(新领域、新短语、版本更新)会改变错误分布,统计应周期性复盘。

操作小贴士(容易落地的办法)

- 每次模型上线,先跑一批自动筛查,再抽样 200–500 条人工复核,看主要错误是否下降;

- 把术语表和领域样本放进优先修复清单,跟踪“术语一致性”的改进效果;

- 对高频错误建立规则拦截或后处理脚本,短期内见效;

- 对长期难以解决的语用错误,重点做上下文增强或对话状态建模。

写着写着,想到一个常被问的问题:模型改进后,报表数据怎么证明“真的好了”?关键在于按相同采样框架和标注准则做 AB 测试,报告带上置信区间,别只看平均值。还有一点,用户感知往往更关注“关键错误是否减少”而非整体错误率,所以把严重度高的类别放到业务看板首位,会更直观。